„Die ich rief, die Geister / werd ich nun nicht los“ (Goethes Zauberlehrling)

San Francisco – Die Botschaft umfasst nur 23 Wörter.

„ Das Risiko der Auslöschung durch Künstliche Intelligenz einzudämmen, sollte weltweit genauso Priorität haben wie das anderer gesellschaftlicher Risiken wie etwa Pandemien und Atomkrieg.“

Veröffentlicht hat diese Botschaft das Zentrum für KI-Sicherheit in San Francisco, unterzeichnet haben sie Hunderte Wissenschaftler und Experten. Darunter führende Forscher auf dem Feld der Künstlichen Intelligenz (kurz: KI), der Chef von Google DeepMind, der Technikchef von Microsoft. Und Sam Altman, dessen Firma „OpenAI“ die Künstliche Intelligenz mit dem Programm „ChatGPT“ gerade so sehr in der Mitte der Gesellschaft ankommen lässt, dass jeder sie versteht und nutzen kann.

KI habe also das Potential, die Menschheit auszulöschen. Wie Seuchen und Atombomben. Das sagt nicht irgendwer. Das sagen die Menschen, die KI erfunden haben, sie weiterentwickeln und mit ihr sehr viel Geld verdienen.

Maschinen, die klüger sind als wir? Die ihre Macht erkennen und sie gegen ihren Erfinder einsetzen wie einst Supercomputer HAL, der schon 1968 im Film „2001: Odyssee im Weltraum“ die halbe Crew des Raumschiffs Discovery um die Ecke brachte?

Die Warnung ist nicht neu. Es sei „schwer vorstellbar, wie man böswillige Akteure davon abhalten will, damit schlimme Dinge anzustellen“, unkte KI-Pionier Geoffrey Hinton in der „ New York Times“. Er warnt vor einem „Tsunami“ an Desinformation mit gefälschten Texten, Bildern und Videos. Der durchschnittliche Mensch sei schon bald „nicht mehr in der Lage zu wissen, was wahr ist.“

KI-Experten wie Gary Marcus und Anka Reuel fürchten laut „ Economist“ die Manipulation von Wahlen und eine „Atmosphäre des totalen Misstrauens“. Sie fordern eine internationale Behörde zur Kontrolle von KI.

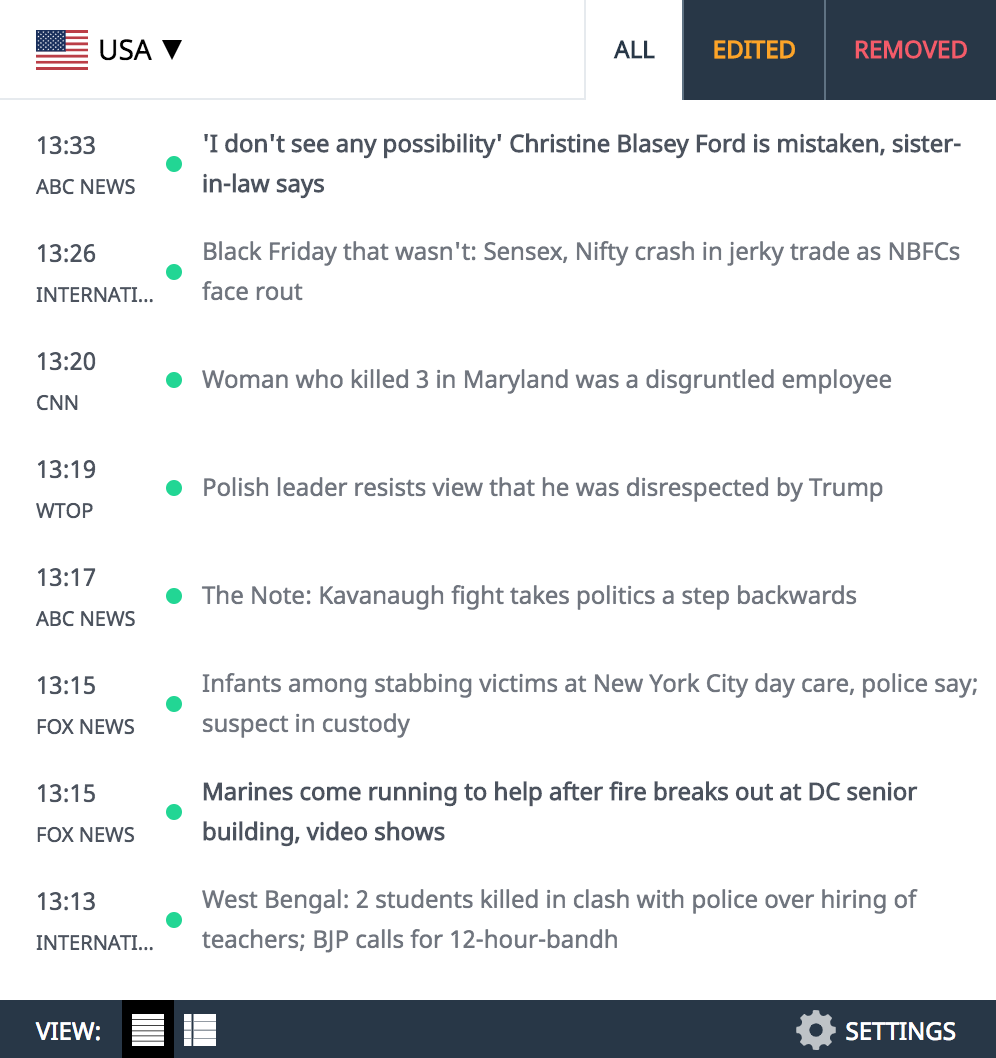

Tesla-Chef Elon Musk posiert neben einem humanoiden Roboter

Foto: -/AFP

Elon Musk und andere Tech-Größen hatten schon Ende März in einem offenen Brief gefordert, die rasante Entwicklung der KI auszusetzen. Und zwar so lange, bis man sicher sei, dass die Auswirkungen positiv und die Risiken überschaubar werden. Im Moment scheinen sie da nicht so sicher.

Sollten wir uns Sorgen machen? Nach Pandemie und Krieg: Schon wieder?

Für KI gilt, was für auch für Feuer, Rad und Penicillin galt: Sie kann die Menschheit immens nach vorn bringen – wenn man sie verantwortungsvoll nutzt. KI kann technisch unterstützte Operationen präziser machen. Sie kann Bomben entschärfen und ins All fliegen, ohne dass Menschen zu Schaden kommen. Sie kann rational entscheiden, wenn Gefühle fehl am Platz sind. Sie ist rund um die Uhr erreichbar, wenn kein Mensch mehr an einer Hotline sitzen will. Sie kann Muster in gigantischen Datenmengen erkennen, so etwa bei der Entwicklung von Medikamenten helfen.

Vor allem in der Medizintechnik kann KI sehr nützlich sein

Foto: Moment/Getty Images

Aber: Sie kennt keine Moral. Wie also umgehen mit einer Technik, die zugleich tödliche Kampfstoffe entwickeln und Krebs heilen kann?

Es liegt an uns, die Entwicklung und den Einsatz von KI verantwortungsvoll zu gestalten, um die Vorteile dieser Technologie zu nutzen und gleichzeitig die damit verbundenen Gefahren zu minimieren.

Diesen Satz hat das KI-Programm „ChatGPT“ für mich geschrieben, als ich es um die Einschätzung von Chancen und Gefahren der KI bat. Da steht, es liege „an uns“.

Vielleicht sollten wir uns doch ein kleines bisschen Sorgen machen.