Le 28 juin 2022, le FBI a mis en garde contre l'utilisation de deep fake par des criminels lors de plusieurs entretiens d'embauche. Le poste de travail associé permettait d'accéder à des informations sensibles.

Dès que la première vidéo deep fake a été diffusée sur YouTube, on soupçonnait que cette technologie serait un jour utilisée par des fraudeurs. Le FBI a confirmé ces inquiétudes dans uncommuniqué de pressele mardi 28 juin 2022. Là, ils appellent à la prudence face à la multiplication des vols de visage. Les criminels se font passer pour d'autres lors d'entretiens vidéo pour des travaux techniques, y compris l'accès à des informations sensibles.

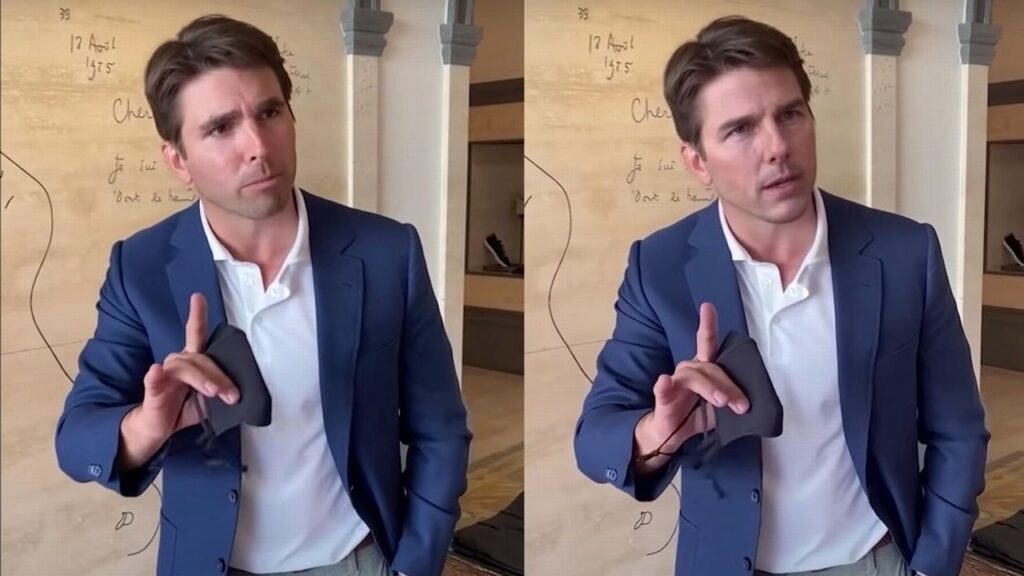

Pour compléter l'arnaque, les escrocs auraient copié les voix d'autres individus, mais c'est ce détail qu'ils ont manqué. "Au cours de ces entretiens, le comportement de la personne interrogée et le mouvement des lèvres ne sont pas en parfaite harmonie avec la voix de la personne qui parle. Des comportements tels que tousser, serrer et autres comportements auditifs. Cependant, il peut ne correspond pas au comportement visuellement présenté», précise le FBI.

La police fédérale américaine affirme qu'une fraude a été tentée pour le travail de développeurs de données et de certaines fonctionnalités logicielles. Certaines des publications ciblées donnaient accès aux informations personnelles, financières et exclusives du client. Les victimes dont les données ont été volées ont déclaré que leur identité avait été utilisée pour vérifier leurs antécédents avant d'occuper d'autres postes.

Outil de détection d'urgence

Deep Fake - Deep Learning - Utilisation de l'intelligence artificielleAnalyser et retranscrire les détails du visage de la même manière que Masu. Cependant, s'il est possible de créer des reproductions apparemment parfaites, les expressions,les mouvements oculaires trahissent souvent cette technique, et les humains sont très doués pour trouver de telles contradictions.

Je ne connais pas le véritable but du criminel, mais le motif de l'adoption est clair. Ce qui est encore plus inquiétant, c'est qu'ils ont pu falsifier des informations et des images volées ou trouvées dans des sources ouvertes. Cela suggère qu'il existe un risque que l'identité de quelqu'un soit usurpée après une fuite de base de données, et il y a de nouveaux rapports d'identité chaque mois. Facebook a développé un outil de détection de faux, mais cette histoire prouve qu'il est urgent de mettre le logiciel à la disposition des professionnels.